当然可以!0基础完全能自学大数据,但这绝对是一条充满挑战但回报丰厚的道路。

我会从以下几个方面为你详细拆解这个问题,并提供一个清晰的学习路径:

正确认识“大数据”

很多人觉得大数据就是Hadoop、Spark这些高大上的技术,这其实是一个误区。大数据是一个技术生态,而不是单一的技术。

它的核心思想是:用一套分布式的、并行的技术体系,来处理、分析、存储远超单台计算机处理能力的数据,并从中挖掘出价值。

学习大数据,你学习的不是一门语言,而是一个技术栈。

0基础自学大数据的优势与劣势

优势:

- 学习动力强: 0基础意味着一张白纸,没有固有的思维定式,可以按照最科学、最系统的路径从头学起,更容易建立起完整的知识体系。

- 时间灵活: 可以根据自己的节奏安排学习,不必受限于课程时间。

- 成本相对较低: 相比报班,自学只需要购买书籍、线上课程等,成本可控。

劣势与挑战:

- 缺乏系统性和方向感: 大数据技术栈庞大且更新快,0基础很容易迷失方向,不知道该先学什么、后学什么,容易走弯路。

- 遇到问题无人指导: 自学过程中遇到bug或概念不理解时,很容易卡住,解决效率低,容易产生挫败感。

- 需要极强的自律性: 学习是一个枯燥且漫长的过程,没有老师和同学的监督,很容易半途而废。

- 缺乏项目经验: 理论知识学完后,如何应用到实际项目中,如何构建一个完整的数据处理流程,这是自学者最大的难点。

0基础大数据学习路线图(核心)

这是最重要的部分,请务必遵循这个由浅入深的顺序。

打好地基(1-2个月)

这个阶段是地基,地基不牢,后面全是空中楼阁。

-

Linux操作系统:

- 为什么学? 大数据框架(Hadoop, Spark等)都运行在Linux集群上,命令行操作是必备技能。

- 学什么? 常用命令(

ls,cd,mkdir,rm,cp,mv,grep,cat等)、用户和权限管理、Shell脚本基础。 - 怎么做? 在自己的电脑上安装一个虚拟机(如VMware/VirtualBox),里面装一个CentOS或Ubuntu系统,每天在里面练习操作。

-

编程语言:

- Python (推荐首选):

- 为什么学? 语法简洁,上手快,是数据分析和机器学习领域的事实标准,有海量的数据处理库(如Pandas, NumPy)。

- 学什么? 基本语法、数据类型、循环、函数、面向对象编程、文件操作。

- Shell脚本:

- 为什么学? 用于自动化运维任务,比如批量处理数据、启动/停止服务,是大数据工程师的必备技能。

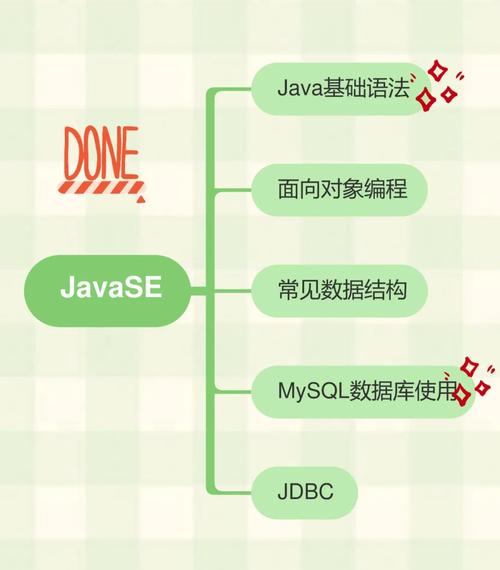

- Java (了解即可):

- 为什么学? Hadoop生态的核心组件(如HDFS, MapReduce, YARN, HBase)都是用Java编写的,了解Java有助于你理解底层原理,阅读源码。

- 学什么? 不需要精通,掌握Java基础语法、面向对象编程(类、对象、继承、多态)即可。

- Python (推荐首选):

-

数据库:

- SQL:

- 为什么学? 这是最重要的数据语言,没有之一! 无论是传统数据库还是大数据处理,SQL都是进行数据查询和提取的通用语言。

- 学什么?

SELECT,FROM,WHERE,GROUP BY,HAVING,JOIN等核心语句,以及窗口函数等高级用法。

- SQL:

进入大数据核心生态(3-6个月)

有了坚实的基础,现在可以正式进入大数据的世界了。

-

Hadoop生态基石:

- HDFS (Hadoop Distributed File System): 学习它的架构(NameNode, DataNode)、存储原理、数据块概念。

- YARN (Yet Another Resource Negotiator): 学习它的资源管理架构(ResourceManager, NodeManager),理解它如何分配集群资源。

- MapReduce: 理解它的“分而治之”思想(Map阶段和Reduce阶段),虽然现在直接用得少了,但它是理解分布式计算的基础。

-

数据仓库工具:

- Hive: 学习它的核心概念,它将SQL语句转换成MapReduce或Spark任务来执行,让你用熟悉的SQL来处理HDFS上的海量数据。

-

资源调度与工作流:

- ZooKeeper: 了解其作为分布式协调服务的作用。

- Flume: 学习如何用它来采集、聚合、移动大量的日志数据。

- Sqoop: 学习如何在关系型数据库(如MySQL)和Hadoop之间进行数据迁移。

- Oozie/Airflow: 学习如何定义和运行复杂的工作流,实现多个任务的自动化调度。

拥抱现代计算引擎(2-3个月)

大数据领域的技术日新月异,Spark是当前的主流。

-

Spark核心:

- 为什么学? Spark比MapReduce快几个数量级,内存计算,是目前最火的分布式计算引擎。

- 学什么?

- Spark Core: 理解其RDD(弹性分布式数据集)的概念和编程模型。

- Spark SQL: 学习使用DataFrame和DataSet API,这是目前最主流的Spark开发方式。

- Spark Streaming: 学习如何处理实时数据流。

- MLlib (机器学习库) / GraphX (图计算库): 根据兴趣选择学习。

-

实时计算框架:

- Flink: 作为Spark Streaming的有力竞争者,在真正的低延迟场景下表现更优,值得了解。

深入与实战(持续进行)

-

消息队列:

- Kafka: 学习它作为高吞吐量、持久化、分布式的消息队列,是构建实时数据管道的核心组件。

-

NoSQL数据库:

- HBase: 学习它构建在HDFS之上的列式数据库,适合海量数据的实时随机读写。

- Redis/MongoDB: 了解它们在特定场景下的应用。

-

实战项目:

- 这是检验学习成果的唯一标准!

- 项目思路:

- 模拟一个电商网站的用户行为分析系统。

- 使用Flume/Kafka采集用户点击日志。

- 将日志数据存入HDFS。

- 使用Hive或Spark SQL进行离线数据分析(如:每日活跃用户、热门商品)。

- 使用Spark Streaming/Flink进行实时数据分析(如:实时热门榜单)。

- 将分析结果存入MySQL或HBase,供前端展示。

给0基础自学者的建议

- 心态调整: 做好打持久战的准备,不要期望一两个月就能精通,保持耐心,享受解决问题的过程。

- 善用资源:

- 视频教程: B站上有很多免费的优质入门课程(如尚硅谷、黑马程序员等机构的公开课)。

- 官方文档: 学会阅读官方文档,这是最权威、最准确的学习资料。

- 技术博客/社区: Stack Overflow、CSDN、掘金等社区是你解决问题的好帮手。

- 动手!动手!动手! 编程是“做”出来的,不是“看”出来的,每个技术点都要亲手敲代码、搭环境、跑项目。

- 先求广度,再求深度: 初期不要纠结于某个技术的底层实现细节,先知道它是什么、能用来做什么、怎么用,有了一定的项目经验后,再回头深入原理。

- 加入学习社群: 找一些同样在自学的朋友,或者加入一些技术交流群,大家互相鼓励、解答问题,可以大大提高学习效率。

0基础自学大数据是完全可行的,但绝非易事。 它要求你具备极强的自学能力、自律性和解决问题的毅力,只要你遵循科学的学习路径,坚持不懈地动手实践,最终一定能成功入门,并在这个充满机遇的领域找到自己的位置,祝你成功!

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。