太棒了!自学大数据并成功找到工作,是完全可行的,但这需要清晰的规划、强大的自律和正确的方法,这条路比科班出身的同学更曲折,但只要你每一步都走扎实,同样能获得很好的职业发展。

下面我为你梳理一个从零到一,再到找到工作的完整路线图和行动指南。

第一阶段:夯实基础,明确方向 (1-3个月)

这个阶段的目标是打好地基,并确定你在大数据领域内的具体发展方向,不要急于求成,地基不牢,后面全是空中楼阁。

知识体系概览

你要明白“大数据”不是一个单一的技术,而是一个技术生态,你需要了解这个生态里都有什么角色:

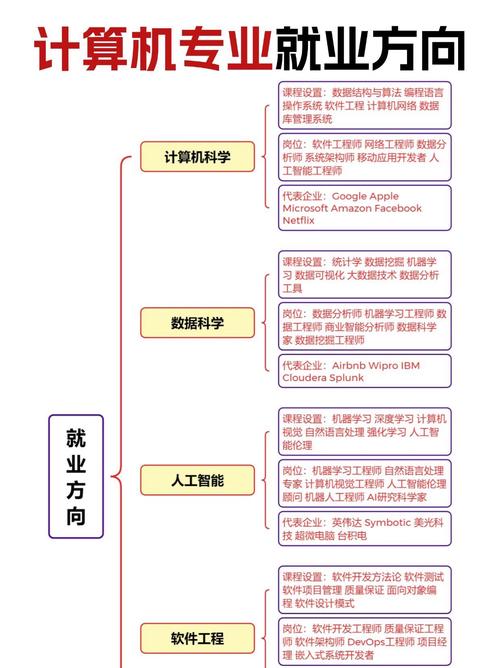

- 数据开发工程师:最主流的岗位,负责搭建和维护大数据平台、数据仓库、数据湖,设计ETL(抽取、转换、加载)流程,确保数据能够稳定、高效地流转,技术栈:Hadoop, Spark, Flink, Hive, HBase, Kafka, Flume等。

- 数据分析师:侧重于使用SQL、Python(Pandas, Matplotlib)等工具对数据进行清洗、探索、可视化,从数据中发现业务问题,提供分析报告,技术栈:SQL, Excel, Python, Tableau/Power BI。

- 数据科学家:更偏向算法和建模,需要较强的统计学、机器学习知识,利用数据构建预测模型,解决更复杂的业务问题,技术栈:Python (Scikit-learn, TensorFlow/PyTorch), 统计学, 高等数学。

- 数据运维工程师:负责大数据集群的部署、监控、调优和高可用保障,技术栈:Linux, Shell, Docker, Kubernetes, Hadoop/YARN生态组件的运维。

给你的建议:对于自学者,从“数据开发工程师”或“数据分析师”入手是最现实的选择,前者是技术核心,后者对编程要求稍低,但业务理解能力要求高。

必备基础知识

无论你选择哪个方向,以下基础知识都是绕不开的:

- 编程语言:

- Python (首选):语法简洁,社区强大,是数据科学领域的“瑞士军刀”,必须掌握基础语法、函数、类,并重点学习 Pandas (数据处理) 和 NumPy (数值计算)。

- SQL (必备):数据世界的“普通话”,必须精通!不仅要会

SELECT,WHERE,GROUP BY,JOIN,还要理解窗口函数、子查询、CTE等高级用法,这是面试必考题。

- Linux操作系统:大数据集群几乎都部署在Linux上,你需要熟悉常用的Linux命令,如

ls,cd,cat,grep,ssh,vi等。 - 计算机网络和操作系统基础:了解TCP/IP协议、HTTP协议等基本概念,有助于你理解数据传输和分布式系统的工作原理。

第二阶段:深入核心,构建技能栈 (3-6个月)

这个阶段是学习的核心,你需要根据第一阶段确定的方向,系统性地学习大数据核心技术。

路径A:数据开发工程师路线

- Hadoop生态入门:

- HDFS (分布式文件系统):理解其架构(NameNode, DataNode)和核心思想。

- MapReduce (分布式计算模型):理解其分而治之的思想,即使现在用得少,面试也常问。

- YARN (资源调度器):理解它如何管理集群资源。

- 数据仓库与SQL进阶:

- Hive:学习如何用SQL-like语法在HDFS上进行数据查询和分析,这是数据开发的核心工具。

- MySQL/PostgreSQL:在单机上练习和存储元数据。

- 新一代计算引擎:

- Spark (重中之重):这是目前业界的主流,必须掌握其核心概念(RDD, DataFrame, Dataset),学习使用 PySpark 进行数据处理,对比Spark和MapReduce的优势。

- Flink:了解其流处理能力,与Spark Streaming进行对比。

- 数据采集与消息队列:

- Kafka:学习作为消息队列,如何实现数据的实时采集和缓冲。

- Flume/Sqoop:了解如何从日志、数据库等数据源采集数据到HDFS。

- NoSQL数据库:

- HBase:了解其列式存储模型,适用于海量数据的实时随机读写。

- Redis:了解其缓存应用场景。

路径B:数据分析师路线

- SQL深度修炼:刷题!刷LeetCode上的数据库题,或者牛客网等平台的SQL专项题,目标是能应对各种复杂的查询场景。

- Python数据分析库:

- Pandas:精通数据清洗、合并、透视、分组聚合等操作。

- Matplotlib & Seaborn:掌握基本图表绘制和数据可视化。

- Jupyter Notebook:熟练使用这个交互式开发环境。

- 统计学基础:学习描述性统计、概率论基础、假设检验、相关性与回归分析等。

- BI工具:学习至少一种主流BI工具,如 Tableau 或 Power BI,制作交互式仪表盘。

- 业务理解能力:这是区分普通分析师和优秀分析师的关键,多看行业报告,思考数据背后的业务逻辑。

第三阶段:实践为王,打造项目 (持续进行)

理论和项目经验,是你在简历上唯一能证明自己的东西。 没有项目,一切都是空谈。

如何做项目?

- 不要只看不练:跟着视频教程敲代码,但最终要能独立复现,甚至进行修改和扩展。

- 从模仿到创造:初期可以复现一些经典项目(如电商用户行为分析、电影推荐系统),然后尝试找一个自己感兴趣的数据集(如Kaggle、天池、政府开放数据平台),独立完成从数据获取、清洗、分析到可视化的全过程。

- 项目要“完整”:一个拿得出手的项目应该包含:

- 明确的目标:解决什么业务问题?(分析用户流失原因,预测商品销量)

- 数据来源:数据从哪里来?(公开数据集、爬虫、模拟生成)

- 技术栈:清晰列出你在项目中使用的技术(如:Python, PySpark, Hive, Kafka, MySQL)。

- 项目流程:ETL流程、数据分析/建模过程。

- 成果展示:最终的报告、可视化图表、或者一个简单的Web应用(用Flask/Django部署)。

项目推荐

- 数据开发方向:

- 模拟一个电商平台的实时数仓项目:用Flume/Kafka采集用户点击日志 -> 存入Kafka -> 用Spark Streaming/Flink进行实时处理 -> 写入HBase/Hive -> 用Hive/Spark进行离线分析。

- 搭建一个离线数仓项目:模拟业务数据库数据 -> 用Sqoop导入HDFS -> 用Hive分层(ODS, DWD, DWS, ADS)进行数据建模和加工。

- 数据分析方向:

- 共享单车数据分析:分析用户骑行规律、潮汐效应、区域热点等。

- 电影数据分析:分析票房、评分、类型、导演之间的关系,构建简单的推荐模型。

- COVID-19疫情数据分析:分析全球或特定国家的疫情发展趋势。

第四阶段:求职冲刺,脱颖而出 (1-2个月)

当你具备了扎实的技能和几个拿得出手的项目后,就可以开始准备求职了。

简历打磨

- STAR法则:用STAR法则(Situation, Task, Action, Result)来描述你的项目经验。

- 反例:“负责了一个数据分析项目。”

- 正例:“Situation:某电商平台用户流失率高达30%。Task:我的任务是找出流失用户的关键特征,并给出运营建议。Action:我使用Python Pandas对过去半年的100万条用户行为数据进行清洗和特征工程,通过逻辑回归模型构建了流失预测模型,并利用Tableau制作了用户画像看板。Result:模型准确率达到85%,识别出3个关键流失原因,被运营团队采纳后,下月流失率降低了15%。”

- 量化成果:尽可能用数字说话,处理了XX GB的数据”,“将查询效率提升了XX%”。

- 关键词匹配:仔细研究目标岗位的JD(职位描述),将简历中的关键词与之对齐。

面试准备

- 技术面试:

- SQL:必刷题!牛客网、LeetCode上的高频题要了如指掌。

- 编程题:用Python解决算法题,重点考察数据处理和逻辑能力。

- 项目深挖:面试官会对你简历上的项目进行“拷问”,你必须能清晰地讲出项目的每一个细节、遇到的困难、如何解决的、为什么用这个技术而不用那个。

- 八股文:准备大数据核心组件的原理题,如“HDFS的副本机制”、“Spark的宽窄依赖”、“Kafka的分区和副本机制”等。

- 行为面试:准备一些常见的行为问题,如“你遇到的最大挑战是什么?”、“你如何与团队成员协作?”等。

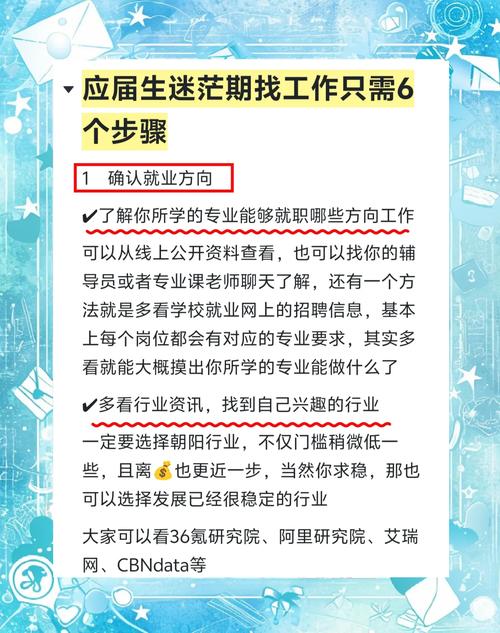

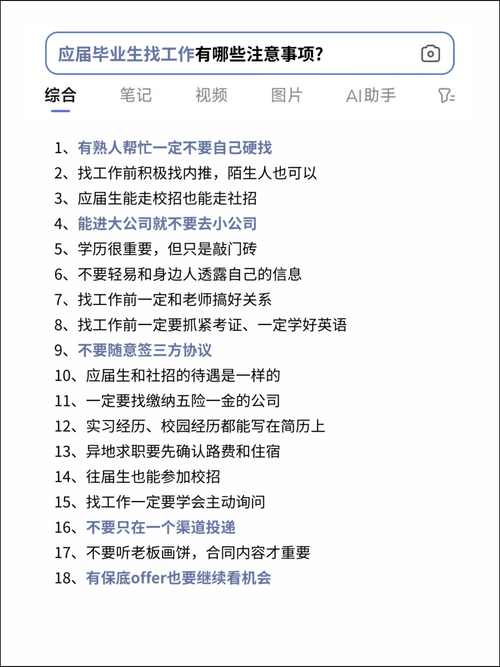

渠道投递

- 招聘网站:Boss直聘、拉勾网、猎聘是主流。

- 内推:这是成功率最高的方式!通过脉脉、知乎、GitHub等平台,找到目标公司的员工,礼貌地请求内推,一份好的内推简历,能直接送到HR和业务负责人手中。

- 实习:如果你还是学生,一份高质量的实习是进入大公司的绝佳跳板。

总结与心态

自学大数据找工作的核心公式:

扎实的理论基础 + 完整的项目经验 + 针对性的求职准备 = 成功Offer

给你的最后几点忠告:

- 保持耐心,拒绝浮躁:这是一个漫长的过程,可能需要半年到一年甚至更久,不要因为一时找不到工作就气馁。

- 持续学习:大数据技术日新月异,今天的主流技术可能明天就会被新的技术挑战,保持学习的热情。

- 构建个人品牌:将你的项目代码上传到GitHub,并写好README文档,在知乎、CSDN等平台分享你的学习笔记和心得,这不仅能帮你巩固知识,还能成为你简历上的一大亮点。

- 不要眼高手低:第一份工作不一定非要进大厂,一些中小型公司同样能提供很好的学习和成长机会,能让你快速积累实战经验。

这条路很难,但走通了,你的技术能力和解决问题的能力会远超同龄人,祝你成功!

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。