太棒了!自学 Python 爬虫是一个非常有趣且实用的选择,它能让你快速获取互联网上的公开数据,无论是用于学习、研究还是商业项目,都非常有价值。

这是一份为你精心设计的,从零基础到进阶的 Python 爬虫自学路线图和资源指南。

第一阶段:基础准备 (打好地基)

在开始写爬虫之前,你需要掌握一些 Python 的基础知识,如果已经是 Python 熟手,可以直接跳到第二阶段。

Python 基础语法

- 核心概念:变量、数据类型(字符串、列表、字典、元组、集合)、条件判断、循环。

- 函数:如何定义和调用函数,理解参数和返回值。

- 面向对象:类和对象的基本概念(虽然爬虫不一定需要,但这是进阶必备)。

- 模块和包:如何使用

import导入标准库和第三方库。

推荐资源:

- 书籍:《Python 编程:从入门到实践》(非常经典,适合新手)

- 在线课程:

- Coursera - "Python for Everybody" (密歇根大学):免费,口碑极佳,适合零基础。

- 廖雪峰的 Python 教程:国内非常受欢迎的免费教程,内容全面。

- 实践:多动手敲代码,解决 LeetCode 上的简单题,巩固基础。

第二阶段:核心库入门 (爬虫的“三驾马车”)

这是爬虫学习的核心,主要围绕三个 Python 库展开。

requests - 发送网络请求

爬虫的第一步是获取网页的 HTML 内容。requests 库让这个过程变得异常简单。

- 学习目标:

- 发送 GET 和 POST 请求。

- 处理响应:获取状态码、响应头、响应内容(文本

text或二进制内容content)。 - 处理 URL 参数和请求头。

- 处理 cookies 和 session(用于登录)。

示例代码:

import requests

# 发送一个 GET 请求

url = 'http://httpbin.org/get'

response = requests.get(url)

# 检查请求是否成功

if response.status_code == 200:

# 打印响应的文本内容

print(response.text)

else:

print(f"请求失败,状态码: {response.status_code}")

BeautifulSoup - 解析 HTML

从 requests 获取到的是一大段原始的 HTML 文本,直接阅读和处理很困难。BeautifulSoup 可以帮你像处理 Python 对象一样,优雅地解析和提取 HTML 中的数据。

- 学习目标:

- 安装

BeautifulSoup和解析器(推荐lxml)。 - 使用标签名、类名、ID 查找元素。

- 使用 CSS 选择器(

.class,#id,div p)精准定位。 - 遍历和搜索元素(

find(),find_all())。 - 提取元素的文本内容和属性(

text,['href'])。

- 安装

示例代码:

from bs4 import BeautifulSoup

import requests

url = 'https://quotes.toscrape.com/'

response = requests.get(url)

soup = BeautifulSoup(response.text, 'lxml')

# 查找所有的引用文本

quotes = soup.find_all('span', class_='text')

for quote in quotes:

print(quote.text)

re - 正则表达式

数据并不在标准的 HTML 标签里,而是隐藏在一段文本中,正则表达式是处理字符串的利器,可以用来匹配、提取、替换复杂的文本模式。

- 学习目标:

- 理解正则表达式的基本元字符(

[]^)。 - 掌握常用模式,如匹配数字、邮箱、手机号等。

- 在 Python 中使用

re模块进行匹配(re.search(),re.findall())。

- 理解正则表达式的基本元字符(

示例代码:

import re text = "联系我: my_email@example.com 或者 support@company.org" # 查找所有邮箱地址 emails = re.findall(r'[\w\.-]+@[\w\.-]+', text) print(emails) # 输出: ['my_email@example.com', 'support@company.org']

第三阶段:实战演练 (从简单到复杂)

掌握了核心库后,通过实践项目来巩固知识。

静态网页爬取

- 目标网站:quotes.toscrape.com (一个专为爬虫练习设计的网站)

- 任务:爬取网站上所有的“名言”和“作者”。

- 涉及技术:

requests+BeautifulSoup。 - 目标:熟练使用

find_all和 CSS 选择器定位数据。

带参数和请求头的爬取

- 目标网站:某电影网站、某电商网站的商品列表页。

- 任务:模拟浏览器行为,爬取特定分类下的商品信息。

- 涉及技术:

- 在

requests.get()中使用params传递 URL 参数。 - 使用

headers参数设置User-Agent等请求头,防止被识别为爬虫。

- 在

- 目标:理解反爬机制的初步形式。

动态网页爬取

- 目标网站:知乎、微博、今日头条等使用 AJAX 或 JavaScript 渲染内容的网站。

- 任务:爬取这些网站上的文章列表或评论。

- 涉及技术:

- 分析网络请求:使用浏览器的开发者工具(F12 -> Network 面板),找到真正返回数据的 API 接口。

- 直接调用 API:分析接口的请求参数(URL、Headers、Data),然后用

requests直接模拟请求,获取 JSON 数据并解析。

- 目标:学会绕过前端渲染,直接获取后端数据。

第四阶段:进阶技巧与反反爬

当你开始爬取大型网站时,会遇到各种反爬措施,你需要学会如何应对。

数据存储

- CSV 文件:使用 Python 内置的

csv模块,适合存储结构化表格数据。 - TXT 文本文件:使用

open()和write(),适合存储非结构化文本。 - JSON 文件:使用

json模块,适合存储结构化数据,易于其他程序读取。 - 数据库:

- SQLite:Python 内置轻量级数据库,无需安装,适合小型项目。

- MySQL / PostgreSQL:使用

pymysql或psycopg2连接,适合大型项目。 - MongoDB:使用

pymongo连接,适合存储非结构化的文档数据。

处理反爬机制

- 设置请求头:模拟浏览器访问,如

User-Agent、Referer。 - 使用代理 IP:当 IP 被封禁时,通过代理池更换 IP。

- 库:

requests+proxies参数。

- 库:

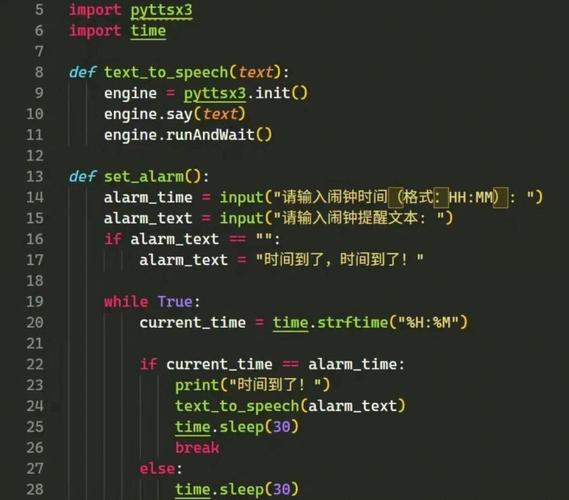

- 控制爬取速度:在两次请求之间加入随机延时,避免对服务器造成过大压力。

- 库:

time.sleep(random.randint(1, 3))

- 库:

- 处理验证码:

- 简单图形验证码:可以使用

pytesseract(OCR库)配合Pillow库进行识别。 - 复杂验证码:通常需要借助打码平台(如超级鹰、打码兔)的 API。

- 简单图形验证码:可以使用

使用 Selenium - 自动化测试工具

当网页极度复杂,或者需要模拟用户点击、输入等操作时,Selenium 是你的终极武器,它可以控制一个真实的浏览器(如 Chrome)来访问网页。

- 学习目标:

- 安装

selenium和对应浏览器的WebDriver。 - 定位页面元素(

find_element_by_id,find_element_by_css_selector等)。 - 模拟用户操作:

click(),send_keys(),submit()。 - 获取页面渲染后的源代码。

- 安装

- 适用场景:需要登录、需要滑动验证码、需要无限下拉加载的网站。

第五阶段:项目部署与框架

当你需要构建一个稳定、高效、可维护的爬虫项目时,可以考虑使用框架。

Scrapy - 爬虫框架

Scrapy 是一个功能强大的爬虫框架,它为你提供了“开箱即用”的解决方案。

- 核心组件:

- Spider:定义如何爬取某个网站,包括初始 URL 和如何跟进链接。

- Item:定义你想要抓取的数据结构。

- Pipeline:定义如何处理抓取到的数据(如清洗、去重、存储到数据库)。

- Downloader Middlewares:处理请求和响应(如设置代理、User-Agent)。

- Scheduler:调度引擎,管理请求队列。

- 优点:异步高效、强大的数据提取器、内置数据导出、易于扩展。

- 学习路径:先掌握前三者,再逐步了解中间件和管道。

学习路线总结

| 阶段 | 核心目标 | 关键技术/库 | 实践项目 |

|---|---|---|---|

| 基础准备 | 掌握 Python 基础语法 | Python 基础语法 | 完成基础教程,做 LeetCode 简单题 |

| 核心入门 | 学习爬虫三驾马车 | requests, BeautifulSoup, re |

爬取静态网页(如名言网站) |

| 实战演练 | 处理不同类型的网页 | 动态网页分析、API 调用 | 爬取电商/社交媒体网站数据 |

| 进阶技巧 | 应对反爬,高效存储 | 代理、延时、验证码、Selenium、数据库 |

构建一个健壮的爬虫系统 |

| 项目部署 | 构建大型爬虫项目 | Scrapy 框架 |

使用 Scrapy 爬取整个网站 |

重要提醒与最佳实践

- 遵守

robots.txt:在爬取任何网站前,先访问www.example.com/robots.txt,查看网站的爬虫协议,规定哪些页面可以爬,哪些不可以。 - 尊重网站服务器:不要设置过高的爬取频率,给服务器留出喘息的时间,你的行为应该是“礼貌的”。

- 检查用户协议:一些网站的服务条款明确禁止爬取其数据,请确保你的行为合法合规。

- 数据合法性:爬取的数据仅用于个人学习、研究或商业分析,切勿用于非法用途(如倒卖数据、侵犯隐私等)。

- 错误处理:网络请求可能会失败,使用

try...except来捕获异常,让你的爬虫更健壮。 - 代码规范:养成良好的编码习惯,使用

pipenv或virtualenv管理项目依赖,保持代码整洁。

自学爬虫是一个“理论 + 实践”不断循环的过程,遇到问题是常态,学会使用搜索引擎(Google、Stack Overflow)和官方文档解决这些问题,是成为优秀程序员的关键。

祝你学习顺利,享受用代码探索互联网的乐趣!