Hadoop课程设计:基于大数据的电影推荐系统

项目概述

1 项目背景

随着互联网和流媒体服务的普及,电影数据(如用户评分、观影记录、电影元数据等)呈现出爆炸式增长,传统的数据处理方法难以高效地从海量数据中挖掘出有价值的用户偏好,实现精准的个性化推荐,Hadoop生态系统作为大数据处理的核心技术,提供了分布式存储和计算能力,能够有效解决海量数据处理和复杂分析的挑战,本项目旨在利用Hadoop生态技术,设计并实现一个可扩展的电影推荐系统。

2 项目目标

- 核心目标: 构建一个能够处理海量电影数据,并基于用户行为数据(如评分)为用户生成个性化电影推荐的系统。

- 技术目标:

- 掌握Hadoop HDFS的分布式文件系统原理与使用。

- 掌握Hadoop MapReduce编程模型,并能独立编写MapReduce程序进行数据处理。

- 了解HBase NoSQL数据库的原理,并利用其存储半结构化数据。

- 熟悉Spark框架的基本使用,特别是其Spark MLlib库,用于实现更高效的机器学习推荐算法。

- 学习使用Hive进行数据仓库管理和SQL式查询。

- (可选)掌握将Hadoop生态组件整合部署到分布式环境(如Linux集群或Docker容器)的方法。

- 能力目标:

- 培养分析复杂业务需求并将其转化为技术实现方案的能力。

- 提升大数据平台架构设计和组件选型的能力。

- 锻炼独立解决技术难题、调试和优化程序的能力。

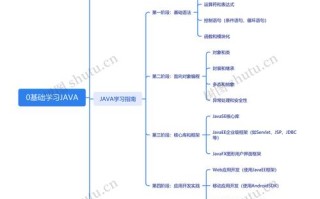

系统总体设计

1 系统架构图

本系统采用经典的大数据处理分层架构,数据从产生到最终推荐结果,流经多个处理阶段。

- 数据源层: 系统的输入数据,包括用户对电影的评分数据、电影基本信息(标题、类型、年份等)。

- 数据存储层:

- HDFS: 作为底层分布式文件系统,用于存储原始数据、中间处理结果和最终模型数据。

- HBase: 用于存储用户-电影评分矩阵等需要快速随机访问的数据。

- 数据处理与计算层:

- MapReduce: 用于数据清洗、预处理、特征提取等ETL(Extract, Transform, Load)任务。

- Spark Core/Spark SQL: 用于执行更复杂的迭代计算,如协同过滤算法,Spark的内存计算特性比MapReduce更适合机器学习任务。

- Spark MLlib: 提供了现成的机器学习算法库,如ALS(交替最小二乘法),用于实现推荐模型。

- 数据服务层:

- Hive: 构建在HDFS之上的数据仓库,通过SQL接口方便地对数据进行查询和分析,可用于生成推荐结果报表。

- 应用与展示层:

一个简单的Web应用或命令行工具,用于接收用户ID,调用后端服务获取推荐结果并展示。

2 技术选型

| 组件 | 版本 | 作用 |

|---|---|---|

| Hadoop | x.x | 提供分布式存储和计算的基础框架。 |

| HDFS | x.x | 分布式文件系统,存储所有数据。 |

| MapReduce | x.x | 批处理任务,用于数据清洗和转换。 |

| Hive | x.x | 数据仓库,提供SQL查询接口。 |

| HBase | x.x | NoSQL数据库,存储用户-电影评分。 |

| Spark | x.x | 内存计算框架,用于快速迭代计算和机器学习。 |

| Spark MLlib | x.x | Spark的机器学习库,实现推荐算法。 |

| Java/Scala | 8 / 2.12 | 主要开发语言。 |

| Maven | x.x | 项目管理和依赖管理工具。 |

数据准备

1 数据集选择

推荐使用公开的、经典的数据集,

- MovieLens (ml-1m 或 ml-20m): 包含用户对电影的评分、时间戳和电影元数据,这是推荐系统领域最常用的数据集之一。

- Netflix Prize Dataset: 更大规模的数据集,但处理起来更复杂,适合进阶学习。

以MovieLens ml-1m为例:

ratings.dat:UserID::MovieID::Rating::Timestampmovies.dat:MovieID::Title::Genresusers.dat:UserID::Gender::Age::Occupation::Zip-code

2 数据上传

将下载的数据集上传到HDFS的指定目录:

# 在Hadoop集群的NameNode上执行 hdfs dfs -mkdir -p /input/movielens hdfs dfs -put /path/to/local/ml-1m/* /input/movielens

核心功能模块实现

1 模块一:数据预处理

-

目标: 将原始数据清洗、转换,并加载到Hive和HBase中,形成规整的数据表。

-

技术: MapReduce 或 Spark

-

步骤:

-

清洗: 过滤掉无效数据(如评分不在1-5之间、用户ID或电影ID为空)。

-

转换: 将时间戳转换为可读的日期格式;将电影类型(如

Action|Comedy)拆分成独立的字段或列表。 -

加载:

-

加载到Hive: 创建Hive外部表,直接指向HDFS上的数据文件,然后创建内部表,存储处理后的干净数据。

-- 创建外部表 CREATE EXTERNAL TABLE raw_ratings ( userid INT, movieid INT, rating INT, timestamp BIGINT ) ROW FORMAT DELIMITED FIELDS TERMINATED BY '::' STORED AS TEXTFILE LOCATION '/input/movielens'; -- 创建内部表(存储处理后的数据) CREATE TABLE clean_ratings ( userid INT, movieid INT, rating FLOAT, date DATE ); -- 使用SQL进行清洗和转换 INSERT INTO TABLE clean_ratings SELECT userid, movieid, rating, FROM_UNIXTIME(timestamp) AS date FROM raw_ratings WHERE rating BETWEEN 1 AND 5; -

加载到HBase: 创建HBase表,将

userid作为行键,movieid和rating作为列族和列 qualifier。# 在HBase Shell中创建表 create 'user_movie_ratings', 'rating'

-

-

2 模块二:推荐算法实现

本模块是系统的核心,推荐采用基于用户的协同过滤和基于物品的协同过滤,并重点实现基于模型的协同过滤。

- 目标: 根据用户的历史评分数据,训练推荐模型,并为指定用户生成Top-N推荐列表。

- 技术: Spark MLlib

2.1 基于用户的协同过滤 (User-CF)

- 原理: 找到与目标用户品味相似的用户群,将这些用户喜欢的、但目标用户未接触过的物品推荐给目标用户。

- Spark MLlib实现思路:

- 将评分数据转换为

RDD[Rating]格式,其中Rating类包含user,product,rating。 - 使用

ALS.train()算法,设置rank,maxIterations,implicitPrefs=false。 - 训练好的模型是一个

ALSModel,包含用户和物品的特征向量。 - 对目标用户,使用

model.recommendProducts()方法生成推荐。

- 将评分数据转换为

2.2 基于物品的协同过滤 (Item-CF)

- 原理: 计算物品之间的相似度,如果一个用户喜欢某个物品,那么与这个物品相似的其他物品也可能被推荐给该用户。

- Spark MLlib实现思路:

- Spark MLlib的ALS算法在内部计算物品的相似度矩阵。使用相同的ALS算法,只需在推荐时调用

model.recommendForUser()即可得到基于物品的推荐结果,ALS本质上是一种基于矩阵分解的模型,可以同时用于User-CF和Item-CF。

- Spark MLlib的ALS算法在内部计算物品的相似度矩阵。使用相同的ALS算法,只需在推荐时调用

2.3 ALS算法实现示例 (Scala/Java)

import org.apache.spark.SparkConf

import org.apache.spark.sql.SparkSession

import org.apache.spark.mllib.recommendation.ALS

import org.apache.spark.mllib.recommendation.Rating

// 1. 创建SparkSession

val spark = SparkSession.builder()

.appName("MovieRecommender")

.master("local[*]") // 本地模式,集群上改为你的master URL

.getOrCreate()

import spark.implicits._

// 2. 加载Hive中的干净数据

val ratingsDF = spark.sql("SELECT userid, movieid, rating FROM clean_ratings")

val ratingsRDD = ratingsDF.map(row => Rating(row.getInt(0), row.getInt(1), row.getDouble(2))).rdd

// 3. 训练ALS模型

val rank = 10 // 特征向量的维度

val numIterations = 10

val model = ALS.train(ratingsRDD, rank, numIterations, 0.01)

// 4. 为用户1生成Top 10推荐

val userId = 1

val recommendations = model.recommendProducts(userId, 10)

println(s"Recommendations for user $userId:")

recommendations.foreach { r =>

// 需要根据movieid去movies表查询电影名

println(s" Movie ID: ${r.product}, Score: ${r.rating}")

}

// 5. 关闭SparkSession

spark.stop()

3 模块三:推荐结果存储与查询

- 目标: 将生成的推荐结果存储起来,并能根据用户ID快速查询。

- 技术: HBase 或 Hive

- 实现:

- 方案A (HBase): 创建一个

recommendations表,行键为userId,列族为rec,列 qualifier为movieid_1,score_1,movieid_2,score_2...,这种方式查询速度快。 - 方案B (Hive): 创建一个Hive表

user_recommendations,包含userid,movieid,predicted_rating字段,方便使用SQL进行复杂分析和报表生成。

- 方案A (HBase): 创建一个

4 模块四:服务接口 (可选)

- 目标: 提供一个简单的服务,接收用户ID,返回推荐结果。

- 技术: 可以用Java/Scala写一个简单的HTTP服务(如使用Spark的HttpServer或Spring Boot),或者直接提供一个命令行脚本。

- 实现:

- 脚本接收一个用户ID作为参数。

- 连接到HBase或Hive,查询该用户的推荐列表。

- 将结果格式化并打印到控制台或返回给HTTP请求。

项目实施步骤

- 环境搭建 (1-2周):

- 安装配置Hadoop、Hive、HBase、Spark单机或伪分布式环境。

- 确保各组件之间能够正常通信和协作。

- 数据准备与预处理 (1周):

- 下载并上传数据集到HDFS。

- 编写MapReduce/Spark程序进行数据清洗,并加载到Hive和HBase。

- 核心算法开发 (2-3周):

- 重点实现Spark MLlib中的ALS推荐算法。

- 进行模型训练,并测试生成推荐结果。

- 结果存储与服务实现 (1周):

- 设计并实现推荐结果的存储方案(HBase/Hive)。

- (可选)开发简单的服务接口。

- 系统测试与优化 (1周):

- 对不同用户进行测试,验证推荐结果的合理性。

- 尝试调整ALS算法参数(

rank,iterations),观察推荐效果的变化。 - (可选)进行性能测试,分析系统的瓶颈。

- 文档撰写与答辩准备 (1周):

- 撰写课程设计报告,包括项目背景、需求分析、系统设计、核心代码、测试结果、总结与展望。

- 制作答辩PPT,准备演示。

课程设计报告撰写要点

一份优秀的课程设计报告应结构清晰、内容详实,建议包含以下章节:

- 简要介绍项目背景、目标、采用的技术和主要成果。

- 目录

- 第一章:绪论

- 1 项目背景与意义

- 2 国内外研究现状

- 3 主要研究内容

- 4 论文组织结构

- 第二章:相关技术与理论

- 1 Hadoop生态系统介绍 (HDFS, MapReduce, Hive, HBase)

- 2 Spark与Spark MLlib介绍

- 3 推荐系统理论 (协同过滤、矩阵分解)

- 第三章:系统需求分析

- 1 功能性需求 (数据预处理、推荐生成、结果查询)

- 2 非功能性需求 (性能、可扩展性)

- 第四章:系统总体设计

- 1 系统架构设计 (附架构图)

- 2 技术选型与理由

- 3 数据库设计 (Hive表结构、HBase表结构)

- 第五章:系统详细设计与实现

- 1 数据预处理模块设计与实现 (附核心代码)

- 2 推荐算法模块设计与实现 (附核心代码,解释ALS原理)

- 3 结果存储与服务模块设计与实现

- 第六章:系统测试与分析

- 1 测试环境与数据集

- 2 功能测试 (截图展示推荐结果)

- 3 性能测试与分析 (不同数据量下的运行时间)

- 4 模型效果分析 (推荐结果的合理性讨论)

- 第七章:总结与展望

- 1 项目总结 (完成了哪些工作,有什么收获)

- 2 不足之处 (系统存在的缺点)

- 3 未来展望 (可以如何改进和扩展,如引入实时推荐、深度学习模型等)

- 参考文献

- 致谢

- 附录 (完整的源代码、关键配置文件等)

创新点与拓展方向

- 创新点:

- 混合推荐策略: 结合基于内容的推荐(如根据电影类型)和协同过滤,提高推荐的准确性和多样性。

- 实时推荐: 引入Kafka、Flink等流处理技术,实现基于用户实时行为的动态推荐。

- 冷启动问题解决: 为新用户或新电影设计专门的推荐策略。

- 拓展方向:

- 可视化展示: 使用ECharts、D3.js等前端库,开发一个Web界面,直观展示用户画像、电影关系网络和推荐结果。

- A/B测试: 设计A/B测试方案,比较不同推荐算法的实际效果。

- 深度学习推荐: 使用Spark MLlib中的深度学习库或TensorFlow on Spark,实现更复杂的深度神经网络推荐模型。

这份课程设计方案为你提供了一个从零到一的完整蓝图,你可以根据自己的兴趣和能力,选择性地实现某些模块,并深入探索其中的技术细节,祝你项目顺利!